-

林分郁闭度是指林木树冠垂直投影面积占林地总面积的比例,是反映林分密度的重要指标,在森林资源调查中尤为重要。在传统的森林资源调查中,获取林分郁闭度的主要方法为抬头望法,该方法耗时耗力,获取的数据精度较低,且只适用于面积小、地势缓的林地,难以在地理环境复杂的大区域内应用。随着数字成像技术的发展,HERBERT[1]提出利用鱼眼相机拍摄全天空相片进行郁闭度估测,扩大了拍摄的林冠范围;濮毅涵等[2]基于普通可见光照片中的树叶、树干和天空进行分类,将估测结果与抬头望法结果进行模型比较,得到决定系数(R2)为0.77,但该方法适用于地形平坦的林区,在地形复杂的山地难以应用。为克服地形因子的限制,不少学者基于卫星遥感影像对乔木林林分郁闭度的提取进行了研究。高云飞等[3]基于SPOT 5影像,对各波段的遥感影像像元亮度值进行组合,建立反演模型,最终得到最佳组合模型的R2为0.66;李擎等[4]为提高模型精度,基于高分二号(GF-2)遥感影像,结合光谱信息、纹理特征和地形因子构建郁闭度估测模型,模型精度达89.82%。然而卫星遥感成本高、时效低、灵活性低[5],相比之下无人机可见光遥感在中小型遥感区域作业中能发挥更大的优势,满足动态森林资源监测的条件和需求,并提供更多可能性[6-8]。苏迪等[9]基于无人机可见光影像,利用主成分分析确定模型的主成分变量,建立郁闭度回归方程,估算精度为83.18%;汪霖[10]结合无人机可见光影像得到的数字正射影像(DOM)和冠层高度模型(CHM),使用阈值法对树冠区域进行提取并计算郁闭度,平均精度为92.93%。以上关于乔木林分郁闭度遥感估测的研究都取得了一定的成果,能够满足林业调查需求,然而,目前基于无人机可见光影像的毛竹林林分郁闭度估测研究为数不多。

毛竹作为中国南方重要的笋、竹两用竹种,是最重要的森林资源之一。第九次全国森林清查结果显示:毛竹林面积为467 hm2,占竹林总面积的73%[11]。由于毛竹林的生长特点(扩鞭)[12-13]和经营特点(择伐),使得林分郁闭度在毛竹林经营中尤为重要,出笋率和采伐结果都将反映在郁闭度上,只有保持适宜毛竹生长的郁闭度,才能提高毛竹生产力。毛竹林多分布在山地丘陵地区,传统的实地调查工作量大、效率低、工作周期长、精确度低。随着无人机技术的发展,无人机林业遥感为实现低成本、高时效、高分辨率、高灵活性的动态森林资源监测提供了技术基础。基于无人机和图像识别技术的单木树冠提取已有一定进展。然而相比其他乔木林,毛竹林竹冠具有特殊性,分为钩梢与未钩梢2种形态,且竹冠鲜少呈单个状态,具有“重叠性”,目前还没有利用现有方法直接获取单株毛竹竹冠的研究。本研究对无人机可见光影像的毛竹林郁闭度估测方法进行了分析,以期为快速获取毛竹林的郁闭度提供参考。

-

研究区位于浙江省湖州市安吉县(30°23′~30°53′N,119°14′~119°53′E),该区地处长江三角洲腹地,属于亚热带季风气候,植被类型为亚热带常绿阔叶林,年均气温为12.2~15.6 ℃,年均降水量为1 100~1 900 mm。研究区内光照充足,雨量充沛,竹资源丰富,竹林总面积达757 km2,占森林面积56.47%,其中毛竹占79.30%,被誉为“中国竹乡”。

-

根据是否钩梢和郁闭度2个因素选设样地,共调查36个10 m×10 m的样地,其中已钩梢毛竹林样地24个,未钩梢毛竹林样地12个。利用研究区数字正射影像目视解译获得毛竹林的郁闭度,未钩梢样地为抛荒毛竹林,处于无人经营状态,郁闭度均大于0.9,故在本研究中不再细分郁闭度等级。样地基本情况见表1。

类型 郁闭度 样地/

个平均胸

径/cm平均树

高/m坡度/

(°)坡向 钩梢 0~0.7 13 8.91 9.9 11.6 北坡 钩梢 0.7~0.8 8 9.03 9.4 16.1 西北坡 钩梢 0.8~1.0 3 8.65 9.2 13.3 北坡 未钩梢 12 8.58 9.6 17.1 东南坡 Table 1. Basic information of plot sites

-

数据采集所用无人机遥感系统为大疆Phantom 4 RTK,飞行系统包括3部分:飞行器、云台相机和遥控器。飞行器提供多方位视觉系统,可稳定飞行和精准悬停,进行航点飞行作业;机身装备机载D-RTK,可提供厘米级高精度准确定位,实现更精准的测绘作业。Phantom 4 RTK配备24 mm广角相机、高精度防抖云台及图像传感器、机械快门,确保成像效果。遥控器的主要功能包括作业设计、远距离信号传输和航拍高清画面实时监测等。

2020年11月18日14:00—15:00,天气晴朗、无风、无云,采用大疆Phantom 4 RTK搭载光学相机对选定研究区域进行拍摄。无人机飞行高度为160 m,飞行范围东西走向为222.82 m,南北走向为106.28 m,航向重叠率为90%,旁向重叠率为80%,飞行路线设计为“S”型路线。拍摄共得原始照片142张,空间分辨率为3.36 cm,照片共3波段:红波段(R)、绿波段(G)、蓝波段(B)。

-

使用大疆智图软件对无人机所获取照片进行图像处理,通过三维重建技术,生成带有空间参考信息的数字表面模型(DSM)和色调自然、无明显接痕的正射影像图。图像处理的主要流程包括:①数据预处理,对照片进行校验、筛选、对齐,剔除一些无法进行后续合成的照片;②空三加密,通过空三计算得到密集点云和纹理;③生成网格,得到带空间参考信息的数字表面模型和数字正射影像。

-

在毛竹林高分辨率遥感影像中,由于影像信息太多、林间空隙太杂,经常会产生“同物异谱”和“同谱异物”现象,而在分类前执行分割能有效解决该问题[14-16]。

多尺度分割是从任意一像元开始,自下而上进行合并的一种分割手段,其参数设置包括分割尺度、形状因子和紧致度因子。其中形状因子的取值为[0,1],它包含了形状和光谱2个方面的意义,取值越大,表示在同质性标准中形状因子所占比例越高,光谱因子所占比例就越低,反之亦然。紧致度因子包含紧致度和光滑度,两者权重之和也为“1”。分割尺度作为各参数中最重要的一项,决定了分割所得的多边形对象内部的异质性,分割尺度越大,所生成的对象面积就越大,数目就越少,反之亦然[17]。本研究采用eCognition软件中的Estimation of Scale Paramater 2(ESP2)插件来确定分割尺度,通过设置一系列的参数进行迭代,计算局部方差以及局部方差变化率(ROC)[18-19],ROC=[VL−(VL−1)]/(VL−1)×100。其中:VL表示尺度为L时分割结果中所有对象局部方差值的方差;VL−1表示尺度为L−1时分割结果中所有对象局部方差值的方差。

本研究对不同类型的毛竹林进行不同参数组合实验,得到不同毛竹林的最优参数组合(表2)。

类型 郁闭度 分割尺度 形状因子 紧致度因子 0~0.7 29 0.3 0.5 钩梢 0.7~0.8 31 0.3 0.5 0.8~1.0 29 0.3 0.5 未钩梢 41 0.3 0.5 Table 2. Optimal parameter combination of different Moso bamboo stands

-

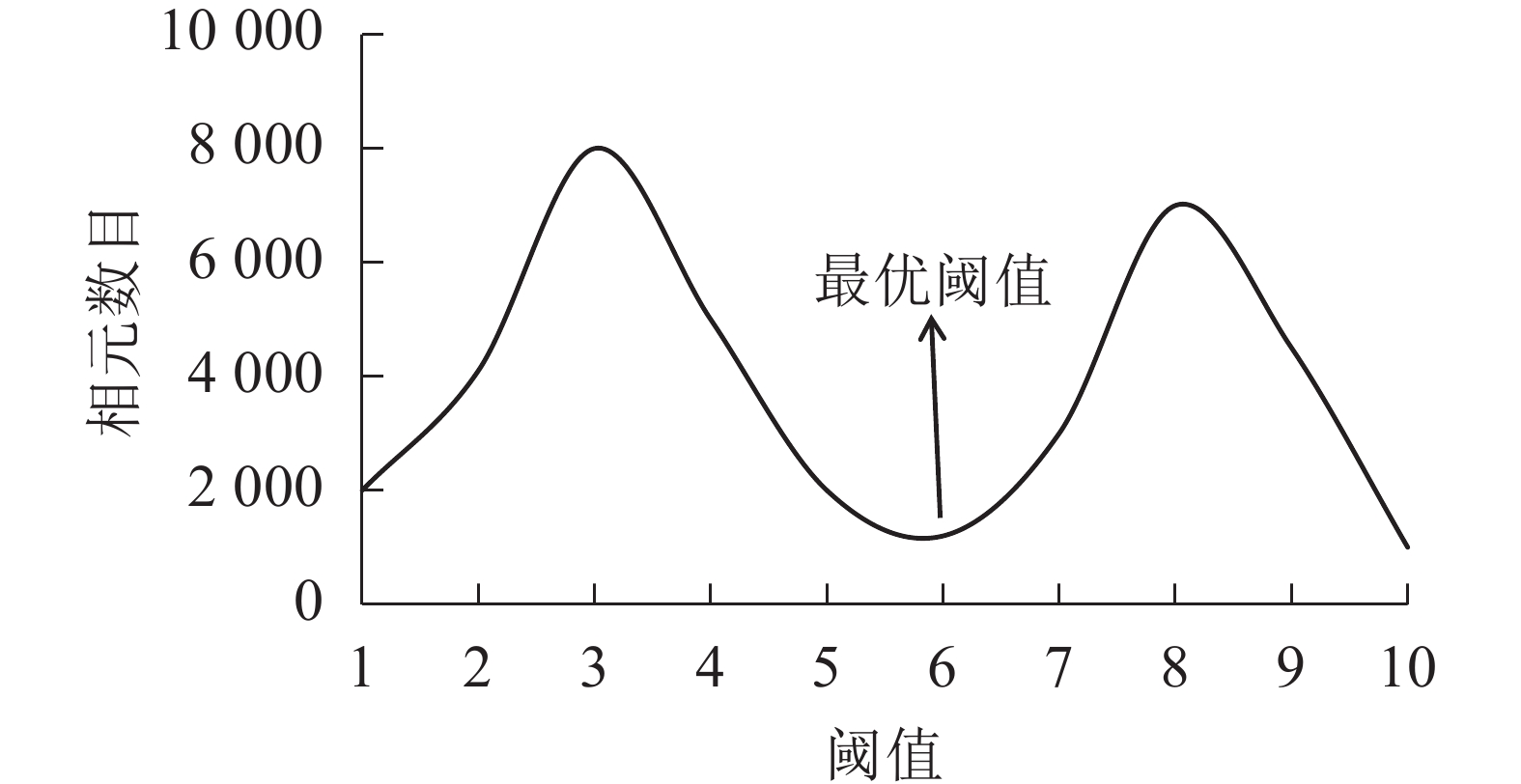

①基于像元的阈值分类(TP)。通过设定不同的特征阈值,将图像分为若干类。常用的特征值包括2类:直接来自于原始图像的灰度或彩色特征和由原始灰度或彩色值变换得到的特征值。基于无人机影像的毛竹林竹冠区域阈值分类的关键在于选取能有效区分竹冠与非竹冠的最优阈值。通过选取竹冠与非竹冠的样点,得到各样点的阈值,统计不同阈值所包含的像元数目,绘成具有明显峰值与谷值的曲线图[20-21]。2个峰值对应位置分别为竹冠与非竹冠的典型特征值,谷值为竹冠与非竹冠交界处对应的特征值,也就是最优阈值(图1)。

特征值的选取对提取精度至关重要,本研究使用ENVI软件对数字正射影像中的红、绿、蓝波段进行主成分分析,得到红光和绿光波段包含98%以上的信息量,故选取由红、绿波段变换得到的归一化绿红差异指数(INGRD)为特征值[22-23],在MATLAB中对竹冠区域进行提取,表达式为INGRD=(G−R)/(G+R)。其中R为红光波段,G为绿光波段。②基于像元的监督分类(SP)。根据已知训练区提供的样本,选取并求出特征参数作为决策规则,建立判别函数对各类图像进行分类的一种方法。本研究建立竹冠区与非竹冠区2种样本,并在ENVI软件中选择最大似然法作为分类算法进行竹冠区域提取,该方法根据训练样本的均值和方差,评价待分类像元和训练样本之间的相似性进而分类,可同时考虑2个以上的波段和类别。③基于多尺度分割的阈值分类(TM)。与传统基于像元的分类不同,基于多尺度分割的阈值分类是一种面向对象分类,其分类的基本单元为影像对象,基本内容分为影像分割与影像分类2个独立模块。结合了多尺度分割的分类方法,在精确分类的同时,很好地兼顾了地物的宏观尺度和微观特征,极大地消除了传统分类带来的“椒盐效应”。在分割的基础上,本研究使用INGRD对竹冠区域进行阈值提取。④基于多尺度分割的监督分类(SM)。该分类也是在多尺度分割的基础上,基于对象进行监督分类。本研究通过eCognition软件进行多尺度分割,并选择最邻近值分类法进行分类提取,该方法通过均匀地选择样本,建立训练集,统计样本的特征信息,通过计算未分类对象与样本之间的距离进行分类,并提取竹冠区域。

-

郁闭度是指树冠的总垂直投影面积(m2)与该样方的总面积(m2)之比,反映林分的密度和林分光能利用程度,是抚育间伐的重要指标,郁闭度=总冠幅/样方总面积。

-

在无人机影像的基础上,根据竹冠部分的亮度、纹理和阴影等特征,在ArcGIS软件中对各个小样地进行目视解译,并以目视解译的结果作为真值对4种方法进行精度评价[24]。分别用正确识别的竹冠总面积(AC,m2)、真实的竹冠总面积(AR,m2)、识别的竹冠面积(AD,m2)、正确识别的非竹冠面积(AN,m2)、样地面积(AS,m2)、真实郁闭度(RD)、分类结果得到的郁闭度(DC)等7个指标进行精度和误差的计算。总体精度(OA)=(AC+AN)/AS×100%;用户精度(UA)=AC/AD×100%;生产者精度(PA)=AC/AR×100%;郁闭度误差(DE)=|RD−DC|。

-

使用SPSS 25.0对各样地的总体精度、用户精度、生产者精度、郁闭度误差进行统计分析,采用单因素方差分析法(one-way ANOVA)进行显著性检验,采用LSD法进行多重比较分析(P=0.05),文中数据为平均值±标准差。

-

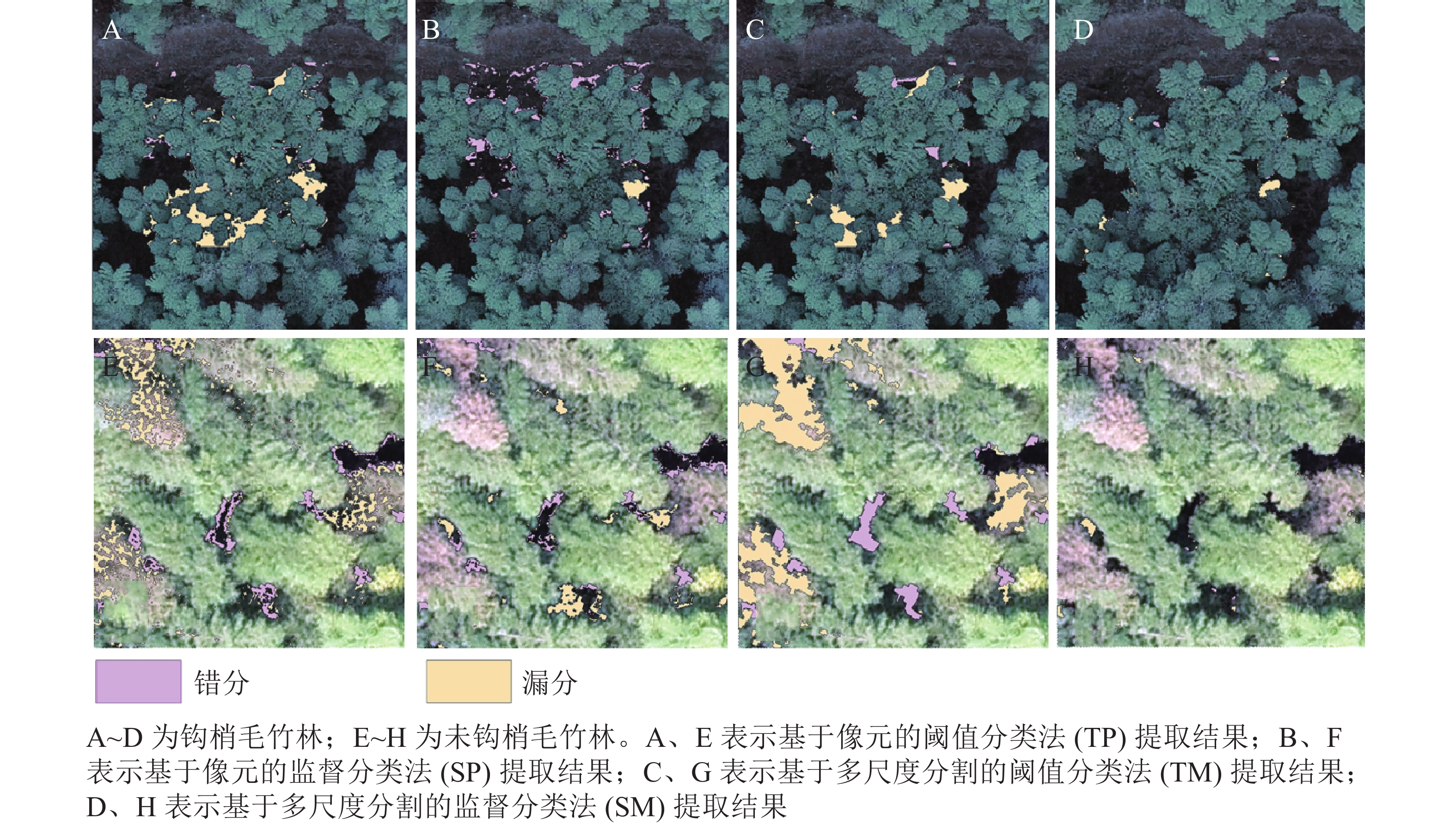

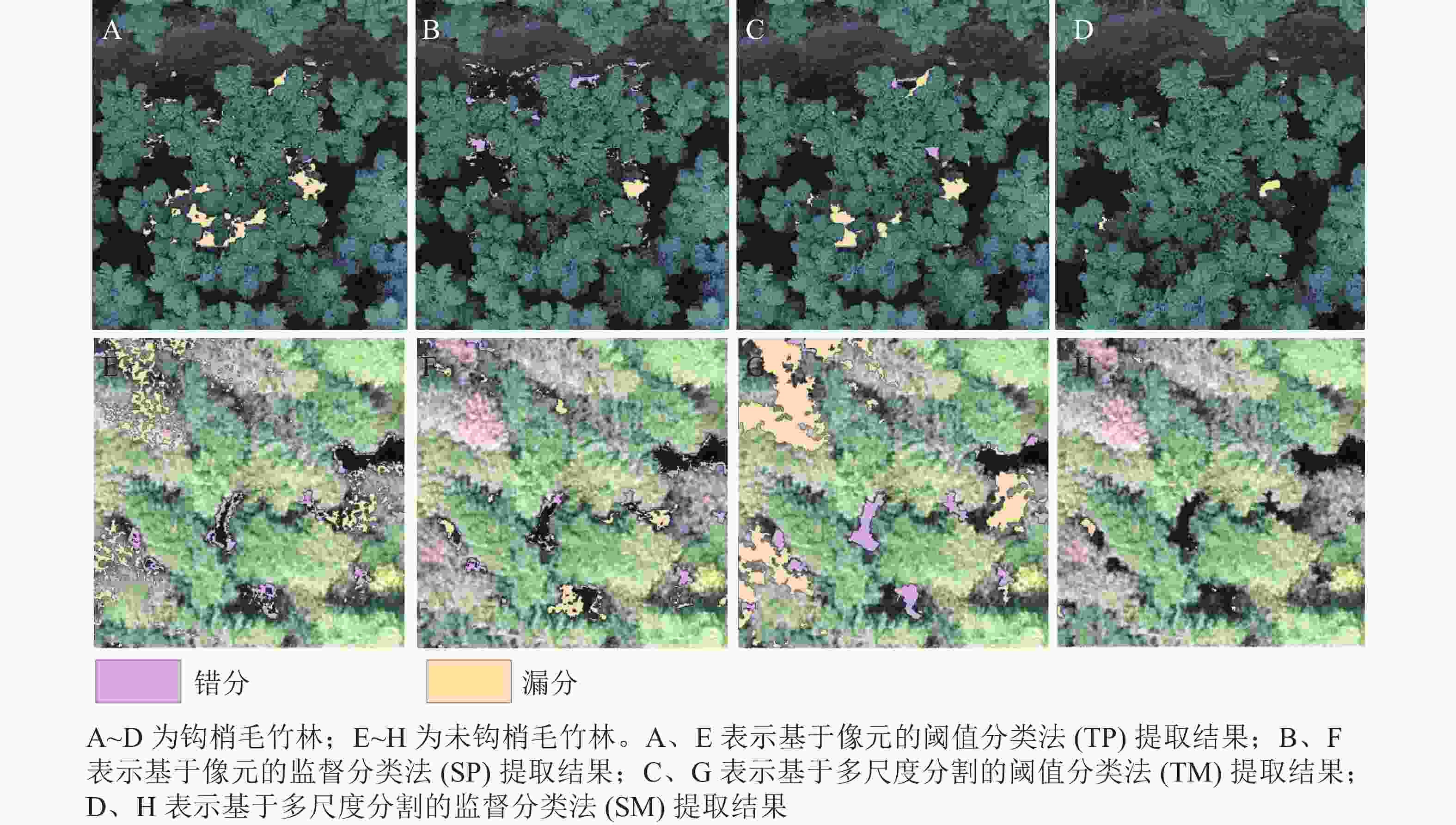

从图2可见:无论是在钩梢毛竹林还是未钩梢毛竹林中,基于像元的阈值分类法的结果存在较多错分和漏分的情况,且提取结果存在“碎片化”情况。基于像元的监督分类法的漏分情况较少,但存在较多的错分且提取结果呈“碎片化”;基于多尺度分割的阈值分类法提取的树冠存在较严重的错分和漏分情况;基于多尺度分割的监督分类法基本解决了树冠提取结果“碎片化”的问题,提高了所提取树冠的整体性,减少了错分和漏分的情况。从表3可以看出:基于多尺度分割的监督分类法的总体精度、生产者精度和用户精度都显著高于其他3种方法(P<0.05);基于多尺度分割的监督分类法郁闭度误差最小,为0.004,显著低于其他3种方法(P<0.05),表明使用基于多尺度分割的监督分类法提取毛竹林郁闭度的结果明显优于其他3种方法。

方法 总体精度/% 生产者精度/% 用户精度/% 郁闭度误差 TP 91.81±3.08 c 93.34±3.37 c 96.24±2.03 b 0.038±0.026 c SP 92.96±3.66 bc 95.47±3.29 b 95.64±2.64 b 0.030±0.026 ab TM 93.47±2.53 b 96.10±2.24 b 95.57±2.57 b 0.024±0.018 b SM 98.86±0.53 a 99.15±0.40 a 99.36±0.53 a 0.004±0.003 a 说明:同列不同小写字母表示差异显著(P<0.05) Table 3. Bamboo crown extraction accuracy and canopy density error of different methods

-

如表4所示:在基于多尺度分割的监督分类法中,是否钩梢对总体精度均没有显著影响,说明基于多尺度分割的监督分类法对钩梢和未钩梢毛竹林均适用;在其他3种方法中,钩梢毛竹林总体精度显著高于未钩梢毛竹林,说明这3种方法更适用于钩梢毛竹林。无论是钩梢林分,还是未钩梢林分,基于多尺度分割的监督分类法的总体精度均显著高于其他3种方法(P<0.05)。

类型 方法 总体精度/% 生产者精度/% 用户精度/% 钩梢 TP 92.82±2.57 Ab 93.85±3.11 Ac 95.96±2.32 Ab SP 93.95±2.74 Ab 96.67±1.39 Ab 95.00±2.98 Ab TM 94.05±2.25 Ab 96.15±2.04 Ab 95.49±2.90 Ab SM 98.9±0.59 Aa 99.14±0.45 Aa 99.27±0.61 Aa 未钩梢 TP 89.80±3.12 Bb 92.33±3.77 Ac 96.81±1.15 Ab SP 90.97±4.52 Bb 93.07±4.57 Bc 96.92±0.98 Bb TM 92.30±2.77 Bb 96.01±2.70 Ab 95.73±1.81 Ac SM 98.78±0.37 Aa 99.16±0.29 Aa 99.55±0.22 Aa 说明:同列不同小写字母表示相同林分类型在不同方法之 间差异显著(P<0.05);同列不同大写字母表示相同 方法在不同林分类型之间差异显著(P<0.05) Table 4. Extraction accuracy of the four methods with truncation and non-truncation

从表5可见:基于多尺度分割的监督分类法所得到的郁闭度误差最小,在钩梢林分中仅为0.003,在未钩梢林分中仅为0.004,显著低于其他3种方法(P<0.05)。在基于多尺度分割的监督分类法和基于多尺度分割的阈值分类法中,是否钩梢对郁闭度误差没有显著影响;在基于像元的监督分类法和基于像元的阈值分类法中,钩梢毛竹林的郁闭度误差显著低于未钩梢毛竹林(P<0.05)。

类型 方法 郁闭度误差 类型 方法 郁闭度误差 钩梢 TP 0.029±0.021 Ab 未钩梢 TP 0.052±0.029 Bc SP 0.023±0.015 Ab SP 0.042±0.039 Bbc TM 0.022±0.016 Ab TM 0.026±0.023 Ab SM 0.003±0.003 Aa SM 0.004±0.003 Aa 说明:同列不同小写字母表示相同林分类型在不同方法之 间差异显著(P<0.05);同列不同大写字母表示相同 方法在不同林分类型之间差异显著(P<0.05) Table 5. Canopy density error of the four methods with truncation and non-truncation

-

从表6可见:4种方法对不同郁闭度毛竹林的总体精度均没有显著影响,说明这4种方法在不同郁闭度的毛竹林中均适用。

郁闭度 方法 总体精度/% 生产者精度/% 用户精度/% 0~0.7 TP 93.70±2.44 Ab 95.04±2.50 Ab 95.26±2.69 Ab SP 94.98±2.11 Ab 97.02±1.37 Ab 95.33±2.90 Ab TM 93.89±2.66 Ab 96.15±2.52 Ab 94.70±3.32 Ab SM 98.82±0.69 Aa 99.11±0.53 Aa 99.09±0.68 Aa 0.7~0.8 TP 92.21±2.65 Ab 92.43±3.83 Ac 97.03±1.68 Ab SP 93.62±4.31 Ab 96.97±1.43 Ab 95.22±4.78 Ab TM 92.71±1.40 Ab 96.11±1.43 Ab 95.19±1.90 Ab SM 98.88±0.48 Aa 99.08±0.32 Aa 99.42±0.48 Aa 0.8~1.0 TP 90.68±1.46 Ac 92.46±1.39 Ac 96.14±0.74 Ab SP 93.62±4.31 Ab 96.97±1.43 Ab 95.22±4.78 Ab TM 92.71±1.40 Ab 96.11±1.43 Ab 95.19±1.90 Ab SM 99.28±0.33 Aa 99.48±0.22 Aa 99.66±0.33 Aa 说明:同列不同小写字母表示相同郁闭度在不同方法之 间差异显著(P<0.05);同列不同大写字母表示相同 方法在不同郁闭度之间差异显著(P<0.05) Table 6. Effect of canopy density on the extraction accuracy under different methods

-

本研究4种方法提取的毛竹林竹冠区域精度均在90%以上,而汪霖等[25]通过提取单个树冠面积,得到提取树冠区域的总体精度为93.09%,高于本研究基于像元的阈值分类法和基于像元的监督分类法,但低于基于多尺度分割的阈值分类法和基于多尺度分割的监督分类法,证明在分类前执行分割能有效提高提取精度。4种方法在竹冠区域提取精度上,基于像元的提取精度小于基于多尺度的提取精度。可能是相比于乔木林,毛竹林由于其扩鞭生长的特殊性,竹冠部分难以单个呈现,具有很强的整体性,使用传统基于像元的提取方法难以达到对整体性的要求。基于多尺度分割的监督分类法表现最好的原因是在保证对象内部同质性最大的基础上进行的分类,且结合了光谱、纹理等信息进行分类,分类依据更全面;而相较于基于多尺度分割的监督分类法,基于多尺度分割的阈值分类法由于分类规则只基于光谱信息,较为单一,故精度较低。

在基于像元的阈值分类法、基于像元的监督分类法和基于多尺度分割的阈值分类法中,是否钩梢对竹冠区域提取的影响存在较大影响。其一是由于未钩梢毛竹林郁闭度过高,林隙较小且颜色与竹冠接近,导致光学影像的饱和度增高,对特征量的敏感度随之下降,造成误差[26-27];其二是由于未钩梢毛竹林一般处于无人经营状态,存在毛竹倒伏现象和新老竹之间的光谱差异,造成误差。但是,基于多尺度分割的监督分类法则不受毛竹林是否钩梢的影响,其原因是多尺度分割得到内部同质性最大、外部同质性最小的斑块,很好保留了分类必需的有效信息,且避免了高分辨率影像中过于丰富的光谱与纹理信息所带来的干扰,减少错分与漏分的情况,基于此进行的监督分类能在保证竹冠整体性的前提下,通过训练样本分别提取钩梢与未钩梢毛竹林的特征参数,从而提取毛竹林竹冠区域。

在4种方法中郁闭度对竹冠区域的提取均不存在显著影响,说明4种方法对不同郁闭度的毛竹林竹冠提取都有较好的适用性。原因是不同郁闭度的毛竹林遥感影像的光谱与纹理特征差别不大,这4种方法都足以从影像中提取稳定的特征量对竹冠区域进行提取。

就郁闭度估测结果而言,4种方法提取的郁闭度误差都小于0.04,其中基于多尺度分割的监督分类法的误差最低,郁闭度误差仅为0.004,说明基于无人机的可见光影像可以用于毛竹林的郁闭度提取,具有很高的应用价值。苏迪等[9]基于冠层高度模型数据进行主成分确定自变量建立郁闭度模型,通过检验得到模型精度为83.18%,低于本研究的估测精度,说明基于影像提取的郁闭度优于建模所得的郁闭度。严羽[28]使用标记控制分水岭算法对树冠区域与非树冠区域进行分割,基于分割得到的树冠区域面积与实测面积对比,得到郁闭度估测误差为2.33%,高于本研究基于像元的阈值分类法、基于像元的监督分类法和基于多尺度分割的阈值分类法,但低于基于多尺度分割的监督分类法。

-

在提取毛竹林竹冠区域和郁闭度的中,本研究基于像元的阈值分类、基于像元的监督分类、基于多尺度分割的阈值分类、基于多尺度分割的监督分类等4种方法都达到了较高精度,其中基于多尺度分割的监督分类法的提取结果精度最高,竹冠区域总体精度为98.86%,郁闭度误差为0.004,显著优于其他3种方法,而且是否钩梢对于基于多尺度分割的监督分类法提取竹冠区域没有影响。在4种方法中,郁闭度对竹冠区域的提取均不存在显著影响。总体上,低廉轻便的无人机搭载可见光相机节省了大量的调查时间与精力,提高了调查效率与精度,可以用于大面积毛竹林竹冠区域和郁闭度的提取。

Estimation method of Phyllostachys edulis forest canopy density based on UAV visible image

doi: 10.11833/j.issn.2095-0756.20210576

- Received Date: 2021-08-19

- Accepted Date: 2022-06-15

- Rev Recd Date: 2022-05-20

- Available Online: 2022-09-22

- Publish Date: 2022-10-20

-

Key words:

- crown density /

- truncation /

- multi-scale segmentation /

- Phyllostachys edulis forest /

- unmanned aerial vehicle (UAV)

Abstract:

| Citation: | WANG Yuyang, WANG Yixiang, LI Mingzhe, et al. Estimation method of Phyllostachys edulis forest canopy density based on UAV visible image[J]. Journal of Zhejiang A&F University, 2022, 39(5): 981-988. DOI: 10.11833/j.issn.2095-0756.20210576 |

DownLoad:

DownLoad: